서울대 박종우 교수 기조강연

서울대 박종우 교수는 5일 열린 ‘KRoC 2026’ 첫 기조강연에서 “VLA(시각-언어-행동)를 다시 생각하다: 로봇 조작 격차 메우기(Rethinking VLAs: Bridging the Manipulation Gap)"를 주제로 강연했다.

이날 기조강연에서 박 교수는 "로봇 조작(manipulation)은 형상과 물성이 제각각인 물체를 대상으로 파지(prehensile)·비파지(nonprehensile) 작업을 수행해야 하며, 접촉 상태에서 운동과 힘을 동시에 정밀 조율해야 한다. 모델과 센싱이 완벽하다면 전통적 모델 기반 제어로도 원칙적으로 풀 수 있지만, 실제 현장에는 마찰·변형·예기치 않은 접촉·센서 잡음 같은 불확실성이 상존한다. 이 때문에 과도한 모델링과 수작업 튜닝이 뒤따르고, 새로운 로봇·작업으로의 일반화가 어렵다는 지적이 계속돼 왔다."고 소개했다.

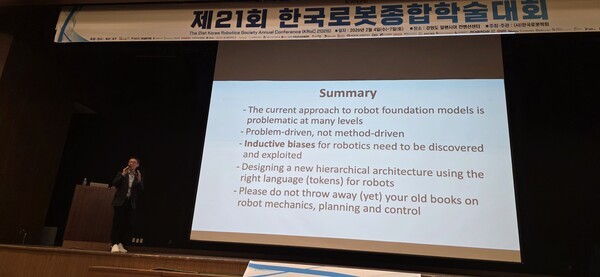

박 교수는 "이런 배경에서 로봇 조작을 위한 파운데이션 모델에 대한 기대가 커졌고, 최근에는 VLA(vision-language-action) 기반 접근이 주류로 부상했다"면서, “현재 로봇 파운데이션 모델의 접근이 여러 수준에서 문제가 있다”고 짚었다. 조작 데이터는 희소하고 하드웨어 의존성이 강해 대규모 수집이 어렵고, 시뮬레이터 역시 마찰·변형 등 복잡한 접촉 현상을 정확히 재현하기 어렵다. 무엇보다 많은 VLA 모델이 ‘위치 중심 출력’에 기대는 탓에, 조작의 본질인 접촉·힘·순응(compliance)을 충분히 반영하지 못한다는 것이다.

박 교수는 ‘방법론(method) 중심’이 아닌 ‘문제(problem) 중심’의 전환을 강조했다. 생성형 AI 이후 “AI를 휴머노이드에 붙이면 곧바로 다 될 것”처럼 보이는 영상이 쏟아지지만, 실제 산업은 반복 작업에서 99.5% 이상 성공률을 요구한다. 자율주행처럼 비교적 구조화된 환경에서도 완전 자율이 쉽지 않은데, 로봇 조작은 환경·물체·접촉 조건이 훨씬 복잡해 “데이터만으로 해결될 것”이라는 기대가 과장되기 쉽다고 경고했다.

대안으로 제시된 핵심 키워드는 “로보틱스 고유의 귀납 구조(Inductive Bias)”를 모델 설계에 반영해야 한다는 것이다. CNN이 위치 불변성 등 영상의 구조를, 트랜스포머가 언어의 조합 관계를 반영했듯, 로봇에는 기구학·동역학·접촉·프레임 변환·제어 모드 등 도메인 고유의 선험 구조가 존재한다. 이를 무시한 채 범용 토큰 체계를 그대로 이식하기보다, 로봇에 맞는 '올바른 언어(tokens)'를 정의하고 이를 바탕으로 새로운 계층형 아키텍처를 설계해야 한다는 주장이다. 즉 상위의 계획·지시가 하위의 역학·제어·순응 조절과 자연스럽게 맞물리도록, 힘과 변위를 통합적으로 다루는 구조가 필요하다는 설명이다.

박 교수는 강연 결론에서 “로봇 파운데이션 모델은 가야 할 길이지만, 지금처럼 VLA에 기능을 덧붙이는 방식만으로는 한계가 크다”며, 로봇 역학·계획·제어와 인간 운동제어에서 유래한 원리를 바닥 레이어로 삼는 설계를 강조했다. 또한 “로봇 메커닉스, 모션 플래닝, 컨트롤의 고전 교과서를 아직 버리지 말라”는 말로, 데이터·스케일의 시대에도 전통 로보틱스 지식이 핵심 기반임을 환기했다.